אפל מנסה להילחם בפורנוגרפיה ועל הדרך יתכן ופוגעת בפרטיות של רבים. אפל פרסמה את תכנית ההגנה החדשה שהיא עומדת להחיל במערכות ההפעלה החדשות iOS 15, WatchOS, MacOS וגם ב- iMessage. במערכות החדשות יהיה ניתן לזהות תמונות פוגעניות בטרם הגיען ליעדן. אפל מעוניינת לשמור על הילדים שלא יחשפו לתמונות פוגעניות ולכן בעזרת בינה מלאכותית ואלוגריתם מיוחד שהיא פיתחה המערכת תדע לזהות תמונות שכאלה.

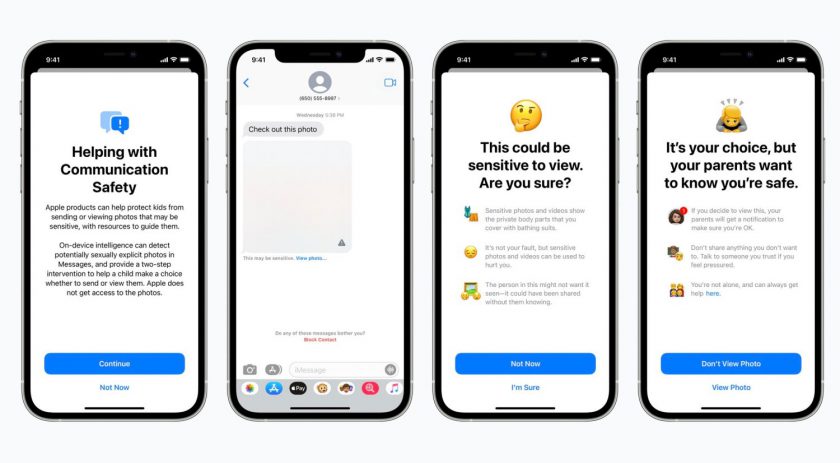

המערכת החכמה תחובר למאגר המידע של National Center for Missing& Exploited Children – NCMEC (המרכז הלאומי לילדים נעדרים ו/או מנוצלים) ומתוכו היא תקבל את כל החומרים המוגדרים כניצול ילדים Child Sexual Abuse Materials – CSAM. המערכת החדשה תעבוד בשני אופנים. הראשון במכשיר עצמו של הקטין (אפל הגדירה את הגיל 13 ומטה), כאשר הוא מקושר לחשבון המשפחתי iCloud Family. ברגע שהקטין יבצע חיפוש באינטרנט של חומרים אסורים ו/או ישלח או יקבל חומרים שכאלה, המערכת תטשטש את החומרים ותתריע בפניו שזהו חומר אסור. במידה והקטין ילחץ על ״הראה תמונה״ יקפוץ לו חלון במכשיר אשר מסביר לו מדוע התמונה מוגדרת כאסורה. במקביל המערכת תשלח הודעה לראש המשפחה בחשבון המשותף, אשר תודיע לו על צפייה בחומרים אסורים.

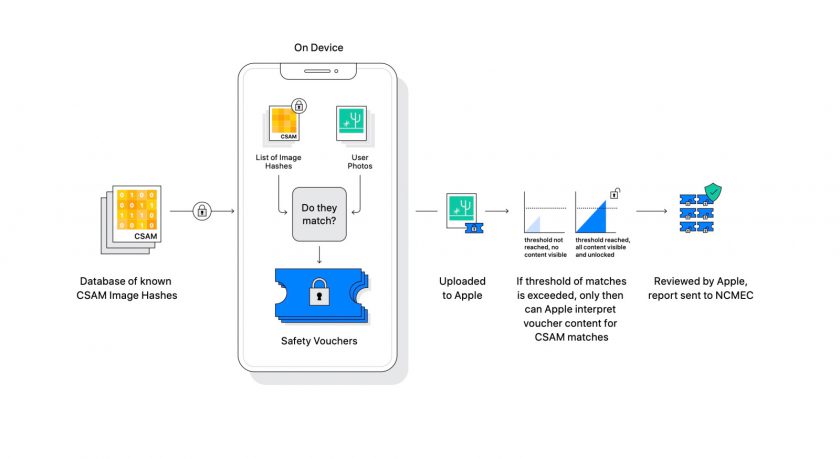

הדרך השנייה כבר מתרחשת בשרתי אפל, ליתר דיוק בחומרים אשר יאוחסנו ב- iCloud. אפל עומדת לסרוק את כל התמונות אשר אמורות לעלות לענן בשרות iCloud עוד בטרם יעלו אליו, כבר במכשיר עצמו. התמונות תעבורנה מנגנון זיהוי והשוואה למאגר של NCMEC ובמידה ותהיה התאמה החשבון ייסגר ותשלח הודעה ישירות ל- NCMEC. על מנת לוודא שהטכנולוגיה לא תפעל לבדה, התמונות החשודות תעבורנה גם בדיקה אישית של בנאדם ולא של רובוט. למרות שביצוע הבדיקה יתבצע במכשיר עצמו עוד בטרם העלייה ל- iCloud הטכנולוגיה תסרוק אך ורק את התמונות אשר אמורות לעלות ל- iCloud ולא את כל התמונות שבמכשיר.

כעת נשאלת השאלה היכן זה ייעצר? היום אלו תמונות פוגעניות ומחר אפל יכולה לדוגמא להחליט על תהליך דומה לכל מה שקשור לקנאביס ו/או סמים אחרים מתוך הטענה של שמירה על בריאות הציבור. הקנאביס הוא רק דוגמא אחת מיני רבות שניתן להעלות על הדעת. מה יקרה עם הממשלה והרשויות יוכלו לקבל גישה למערכת של אפל ולמשתמשים אשר נחסמו? מה יקרה אם הטכנולוגיה הזו תעבור לממשלה והיא תרצה להשתמש בה במלחמה בטרור? היכן הגבול עובר?